机构名称:

¥ 1.0

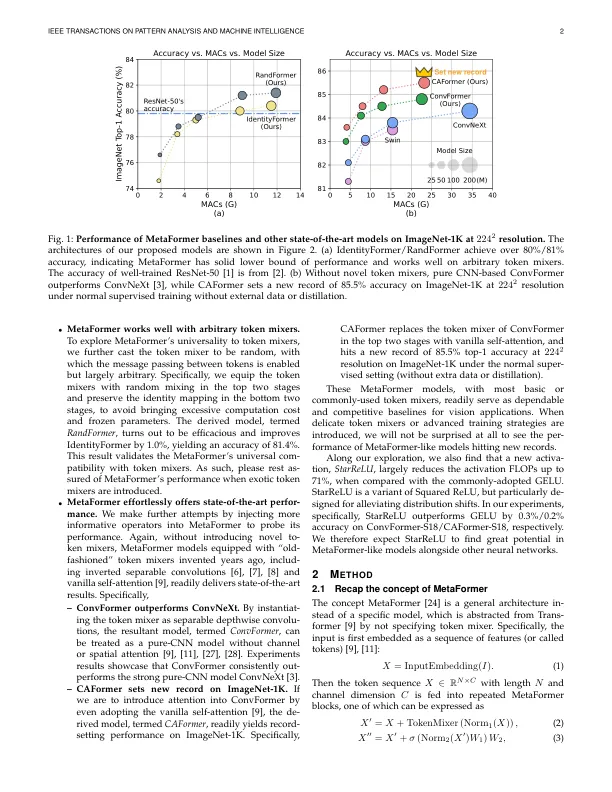

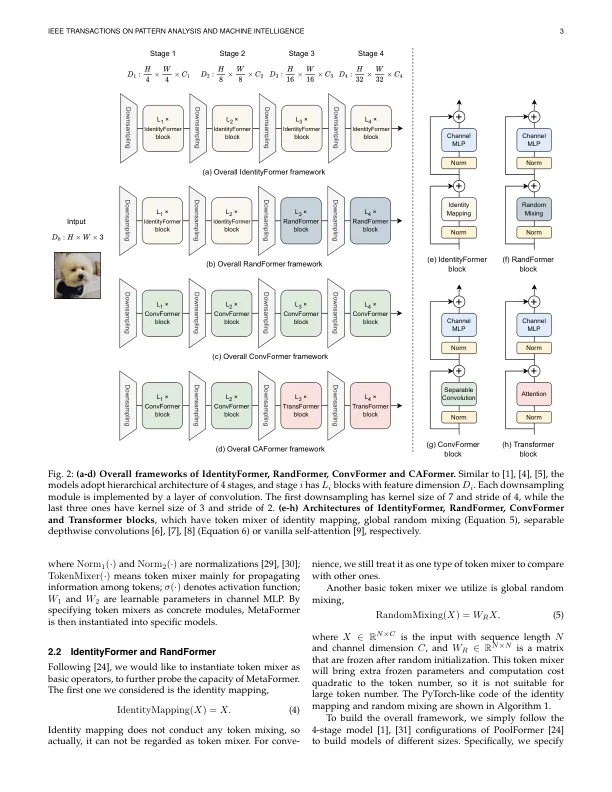

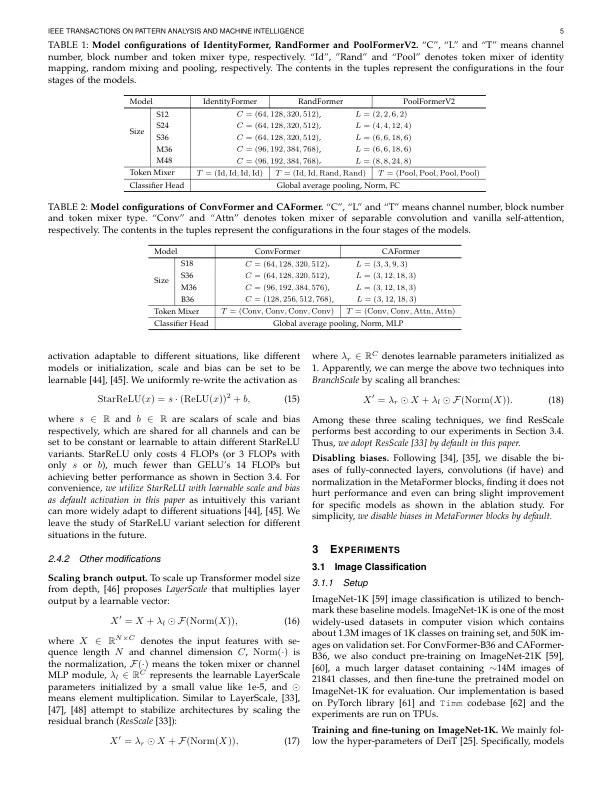

近年来,变形金刚[9]在各种计算机视觉任务[10],[11],[12],[13]中表现出了不前期的成功。变压器的能力长期以来一直归因于其注意力模块。因此,已经提出了许多基于注意力的令牌混合器[4],[5],[14],[15],[16],目的是为了增强视觉传输(VIT)[11]。尽管如此,一些工作[17],[18],[19],[20],[21]发现,通过用空间MLP [17],[22],[23]或傅立叶变换[18]等简单操作员更换变压器中的注意模块,结果模型仍然会产生令人鼓舞的性能。沿着这条线,[24]将变压器摘要为一种称为元构造器的通用体系结构,并假设是元构造者在实现竞争性能中起着至关重要的作用。To verify this hypothesis, [24] adopts embarrassingly simple operator, pooling, to be the token mixer, and discovers that PoolFormer effectively outperforms the delicate ResNet/ViT/MLP-like baselines [1], [2], [4], [11], [17], [22], [25], [26], which con- firms the significance of MetaFormer.

视觉的元构基准