机构名称:

¥ 1.0

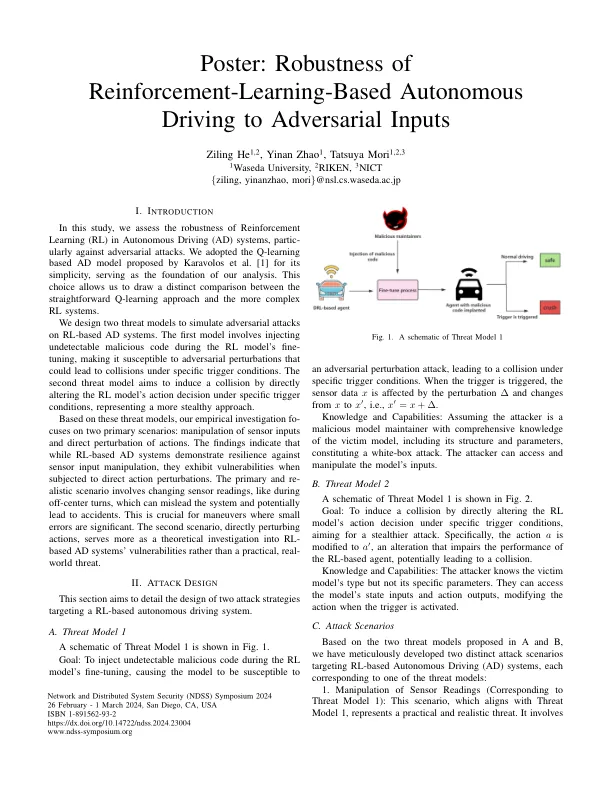

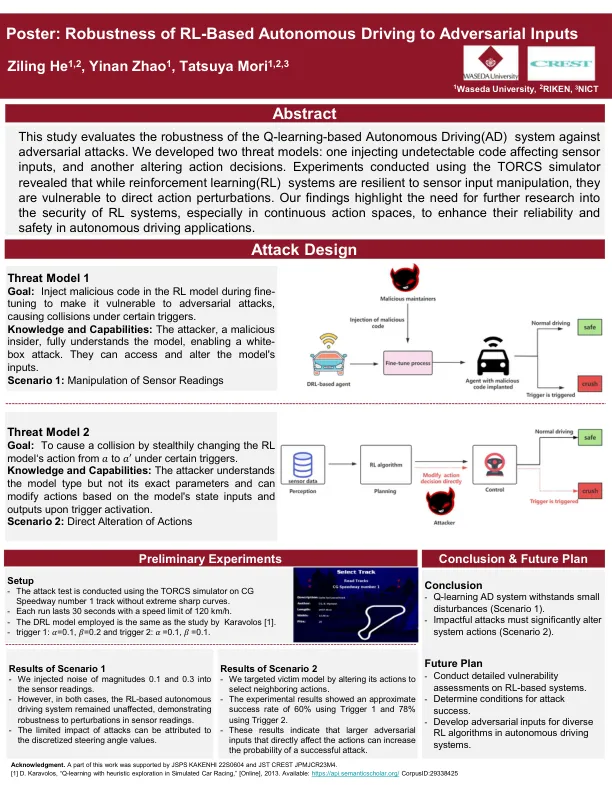

在这项研究中,我们评估了自主驾驶(AD)系统中增强学习的鲁棒性(RL),特别是反对对抗攻击的稳健性。我们采用了Karavolos等人提出的基于Q学习的AD模型。[1]的简单性,是我们分析的基础。此选择使我们能够在简单的Q学习方法和更复杂的RL系统之间进行明显的比较。我们设计了两个威胁模型,以模拟对基于RL的广告系统的对抗性攻击。第一个模型涉及在RL模型的细调中注入未发现的恶意代码,使其容易受到对抗性扰动的影响,这可能会导致在特定的触发条件下碰撞。第二个威胁模型旨在通过直接改变RL模型在特定触发条件下的行动决策来引起碰撞,这代表了一种更隐秘的方法。基于这些威胁模型,我们对两种主要情况的实证研究提出:操纵传感器输入和直接对动作的扰动。研究结果表明,尽管基于RL的AD系统表现出针对传感器输入操纵的弹性,但在受到直接动作扰动时它们会表现出脆弱性。主要的和宽容的场景涉及更改传感器读数,例如在偏心转弯期间,这可能会误导系统并可能导致事故。这对于小误差很大的操作至关重要。第二种情况直接扰动动作,更多地是对基于RL的AD系统脆弱性的理论研究,而不是实用的现实世界威胁。

海报:基于加强学习的自主行动的鲁棒性驱动到对抗性输入

主要关键词