机构名称:

¥ 1.0

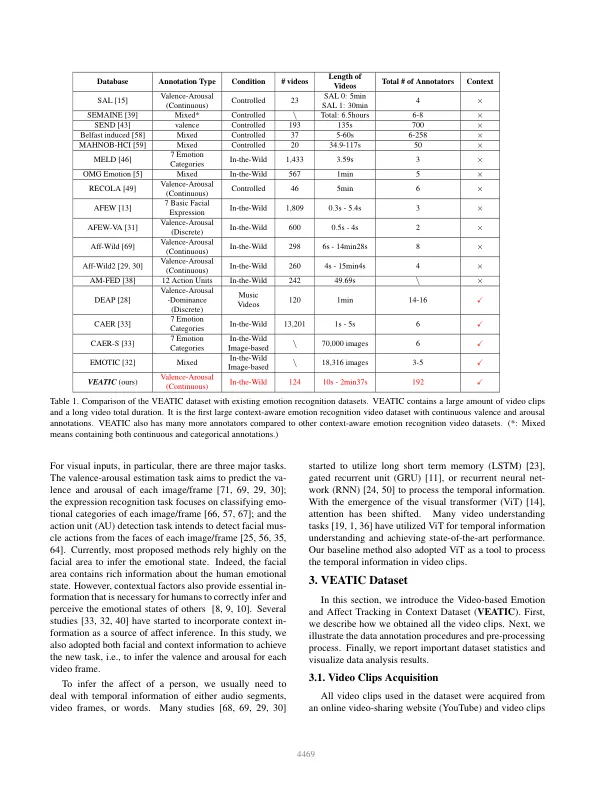

人类情感识别一直是心理物理学和计算机视觉的重要主题。但是,经常发布的数据集有许多局限性。进行检查,大多数数据集都包含仅包含有关面部表情的信息的框架。由于以前的数据集的局限性,很难理解影响人类识别的机制,或者在这些数据集中训练的计算机视觉模型上对人类的识别良好。在这项工作中,我们介绍了一个全新的大型数据集,基于视频的情感并影响上下文数据集(VEATIC)中的跟踪,可以征服先前数据集的限制。Veatic在好莱坞电影,纪录片和家庭视频中有124个视频片段,并通过实时注释进行了连续的价和唤醒评级。与数据集一起,我们采用了一项新的计算机视觉任务,以通过每个视频框架中的上下文和字符信息来推断所选字符的影响。此外,我们提出了一个简单的模型来基准这项新的计算机视觉任务。我们还使用数据集与其他类似数据集进行了预处理模型的性能。实验显示了通过VEATIC验证的模型的竞争结果,表明VEATIC的普遍性。我们的数据集可从https://veatic.github.io获得。

基于视频的情感并影响上下文数据集中的跟踪

主要关键词