机构名称:

¥ 1.0

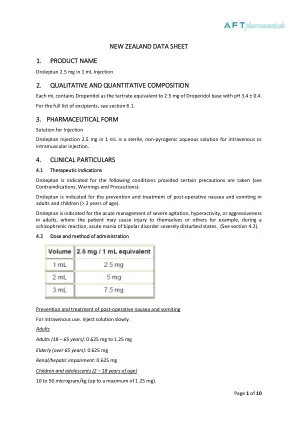

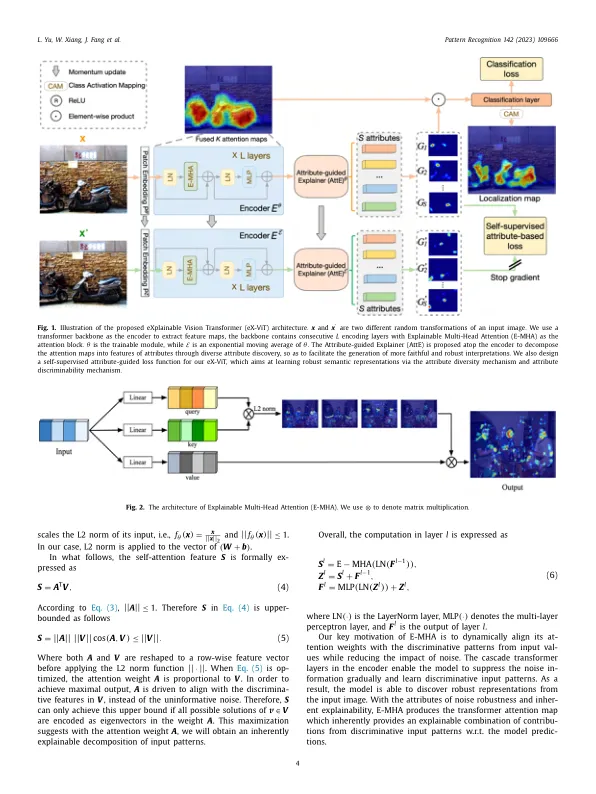

最近视觉变压器模型已成为多种视觉任务的重要模型。这些模型通常是不透明的,具有弱特征可解释性,使用户的预测差。虽然对解释模型决策的事后解决方案的开发产生了兴趣,但这些方法不能广泛应用于不同的变压器体系结构,因为可解释性规则必须基于数据和模型结构的异质性进行相应的变化。此外,目前没有为本质上可解释的变压器构建的方法,该方法能够解释其推理过程并提供忠实的解释。为了缩小这些关键的差距,我们提出了一种新型视觉变压器,称为“可解释的视觉变压器”(Ex-Vit),这是一种可解释的变压器模型,能够共同发现可鲁棒的可解释特征并执行预测。特定于特定的,前vit由可解释的多头注意(E-MHA)模块组成,属性引导的解释器(ATTE)模块具有自我监督的属性引导损失。E-MHA裁缝可解释的注意力权重,能够从具有噪音稳健性的模型决策中从代币中学习可解释的表示表示。与此同时,通过各种属性剖面构成了目标对象的区分属性特征,该特征构成了模型预测的忠实证据。结果,提议的前武率模型可以用各种学习的属性产生忠实而强大的解释。此外,我们为前武器架构开发了一种自我监督的属性引导损失,该体系结构既利用了属性的可行性机制和属性多样性机制来提高学习成分的质量。为了验证和评估我们的方法,我们将前vit应用于几个弱监督的语义细分(WSS)任务,因为这些任务通常依赖于准确的视觉解释来提取对象本地化图。尤其是,通过前视图获得的解释结果被认为是训练WSSS模型的伪分段标签。综合模拟结果幻想表明,我们提出的前武器模型可以达到与监督基线相当的性能,同时仅使用仅使用图像级标签的最先进的黑盒方法超过了最先进的黑盒方法的准确性和解释性。

ex -vit -researchOnline@jcu

主要关键词

![arXiv:2304.03430v1 [nucl-ex] 2023 年 4 月 7 日](/simg/b/b78b7ed6ccbc59e3c4e3e6b2eeac632dd57c51d8.webp)

![arXiv:2211.16981v2 [nucl-ex] 2023 年 6 月 7 日](/simg/e/eeb475db801c282709811fe8d5a31323d470c60e.webp)

![arXiv:2203.07242v1 [hep-ex] 2022 年 3 月 14 日](/simg/8/8735c123db71e7eb9bb3ca5a7db7fb5409490f59.webp)

![arXiv:2305.08705v4 [nucl-ex] 2023 年 7 月 23 日](/simg/1/13dd8be113d094ca8c7fc8d8a074deb635373a82.webp)

![arXiv:2002.04847v1 [nucl-ex] 2020 年 2 月 12 日](/simg/0/067b8dd69b88160a63c5a5ac651b78284ee0daeb.webp)

![arXiv:2111.05042v1 [nucl-ex] 2021 年 11 月 9 日](/simg/d/d40a0dd504343fa1cf48b1dcc93296ab388e8e5d.webp)

![arXiv:2109.10983v1 [nucl-ex] 2021 年 9 月 22 日](/simg/2/2c65a3f7a223fcdbe338740617461ef8179f9846.webp)

![arxiv:2401.04838v1 [nucl-ex] 2024年1月9日](/simg/a/a7392fa710e7128873673417b675fdae90533ac3.webp)

![arxiv:2308.01540v3 [hep-ex] 2023年12月19日](/simg/7/7169ca269e655c87d2aa0220aa0b0d612b258e65.webp)

![arxiv:2302.11759V2 [nucl-ex] 2023年8月26日](/simg/d/d31c3568112267ed888a8dc0f062fb4ceba43401.webp)

![arXiv:2212.07279v1 [hep-ex] 2022 年 12 月 14 日](/simg/3/3c0a730da956267561f713f54b713fe592109657.webp)

![arXiv:2011.06291v1 [nucl-ex] 2020 年 11 月 12 日](/simg/e/ec2986243dc1bfa57944e94ee9c4caf71a6e6a5b.webp)

![arXiv:2112.07987v1 [nucl-ex] 2021 年 12 月 15 日](/simg/8/8b1432d7bde1b905f35717db8a58115df6fb5234.webp)

![人工智能 1 冬季学期 2024/25 [1ex]– 讲义 – 第一部分:人工智能入门](/simg/f/f0cf70b6de21763e3cad1bca114e1ea2343f96bf.png)