机构名称:

¥ 5.0

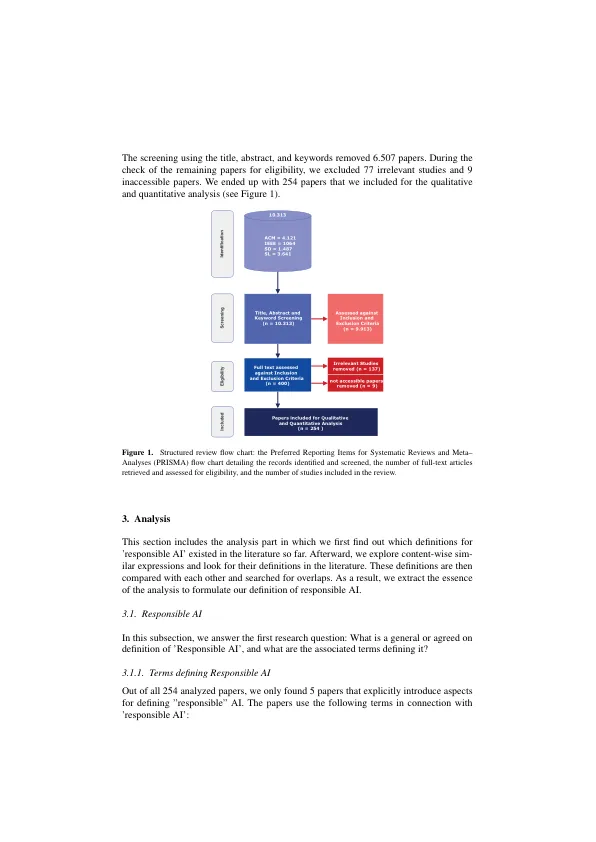

摘要。我们的研究致力于推进负责任的人工智能 (AI) 概念,这一主题在欧盟政策讨论中越来越重要。欧盟最近发布了几份出版物,强调信任人工智能的必要性,强调人工智能既是有益的工具,也是潜在的武器。这种二分法凸显了国际监管的迫切需要。同时,需要有框架来指导公司进行人工智能开发,确保遵守此类法规。我们的研究旨在帮助立法者和机器学习从业者驾驭不断变化的人工智能监管格局,确定未来关注的重点领域。本文介绍了一个全面的、据我们所知的第一个统一的负责任人工智能定义。通过结构化的文献综述,我们阐明了目前对负责任人工智能的理解。根据这一分析,我们提出了一种以这一概念为中心的未来框架的开发方法。我们的研究结果主张以人为本的负责任人工智能方法。这种方法涵盖了人工智能方法的实施,重点强调道德、模型可解释性以及隐私、安全和信任的支柱。

负责任的人工智能:结构化文献综述

主要关键词