机构名称:

¥ 3.0

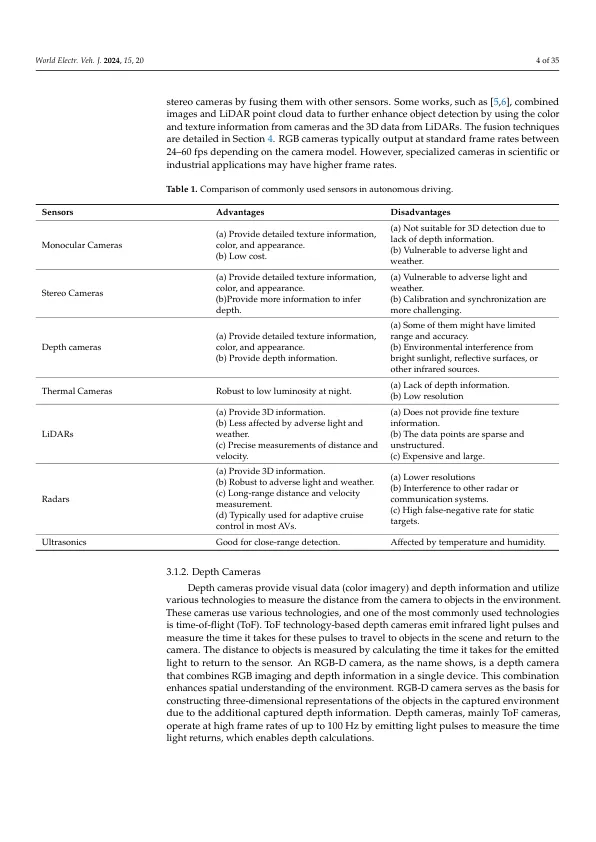

摘要:对自主驾驶的追求依赖于开发能够做出准确,健壮和快速决策以有效解释驾驶环境的感知系统。对象检测对于理解这些系统核心的环境至关重要。随着计算机视觉(CV)应用中深度学习的出现(DL)的出现,2D对象检测和分类已经显着提高,但它们在提供必要的深度信息方面缺乏,这是理解驾驶环境中的关键要素。因此,3D对象检测成为自动驾驶和机器人技术的基石,提供对象位置的精确估计并增强环境理解。CV社区对3D对象检测的兴趣日益增长,这是由DL模型的演变推动的,包括卷积神经网络(CNN)和变形金刚网络。尽管有这些进步,但在3D对象检测中仍存在诸如不同对象量表,有限的3D传感器数据和阻塞等挑战。为了应对这些挑战,研究人员正在探索多模式技术,这些技术结合了来自摄像机,雷达和激光镜等多个传感器的信息,以增强感知系统的性能。本调查对基于多模式融合的3D对象检测方法进行了详尽的审查,重点是基于CNN和基于变压器的模型。它强调了为完全自动驾驶汽车提供不同传感器的必要性,以确保可靠和可靠的操作。调查探讨了相机,激光雷达和雷达传感器的优点和缺点。此外,它总结了自治数据集并研究了基于多模式融合方法的最新进步。调查结束时,强调了正在进行的挑战,开放问题和未来研究的潜在方向。

3D对象检测的多模式融合

主要关键词