机构名称:

¥ 1.0

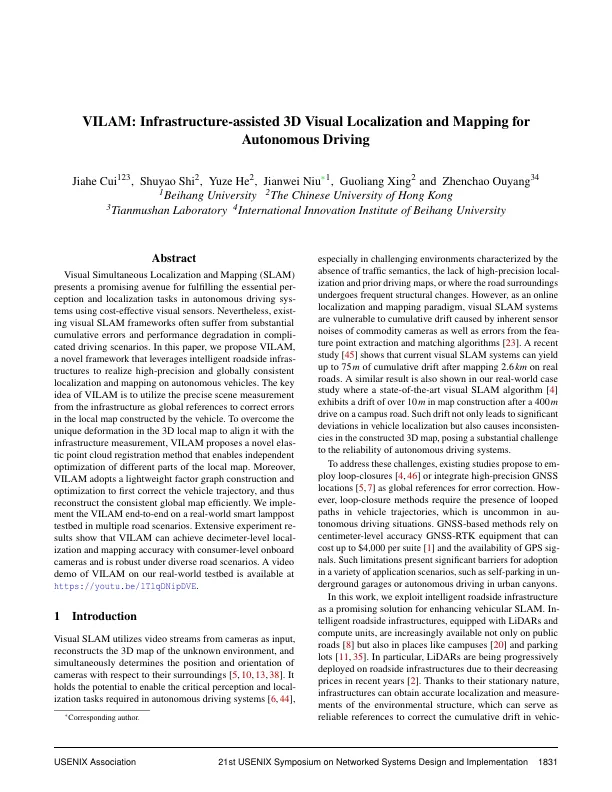

视觉同时本地化和映射(SLAM)提出了一种有希望的途径,以实现使用具有成本效益的视觉传感器的自主驾驶系统中必不可少的受理和本地化任务。然而,存在视觉大满贯框架通常会遭受重大累积错误和在互补的驾驶场景中的性能下降。在本文中,我们提出了Vilam,这是一个新颖的框架,利用智能的路边基础设施实现高精度和全球一致的本地化和自动驾驶汽车的映射。VILAM的关键思想是利用基础架构的精确场景测量作为全局引用,以纠正车辆构造的本地地图中的错误。为了克服3D局部图中的唯一变形,以使其与基础架构测量一致,Vilam提出了一种新型的Elastic Point云注册方法,该方法可以独立优化本地地图的不同部分。Vilam采用了轻质因子图构造和优化,以首先纠正车辆轨迹,从而有效地重建了一致的全局地图。我们在多个道路场景中的真实世界智能灯柱测试中启动了Vilam端到端。广泛的实验表明,Vilam可以通过消费者级别的板载摄像头实现分解级级别的局部iZation和映射准确性,并且在多样化的道路场景下非常强大。在我们的实际测试床上的Vilam视频演示,请访问https://youtu.be/ltlqdnipdve。

vilam:基础架构辅助3D视觉定位和自动驾驶的映射

主要关键词